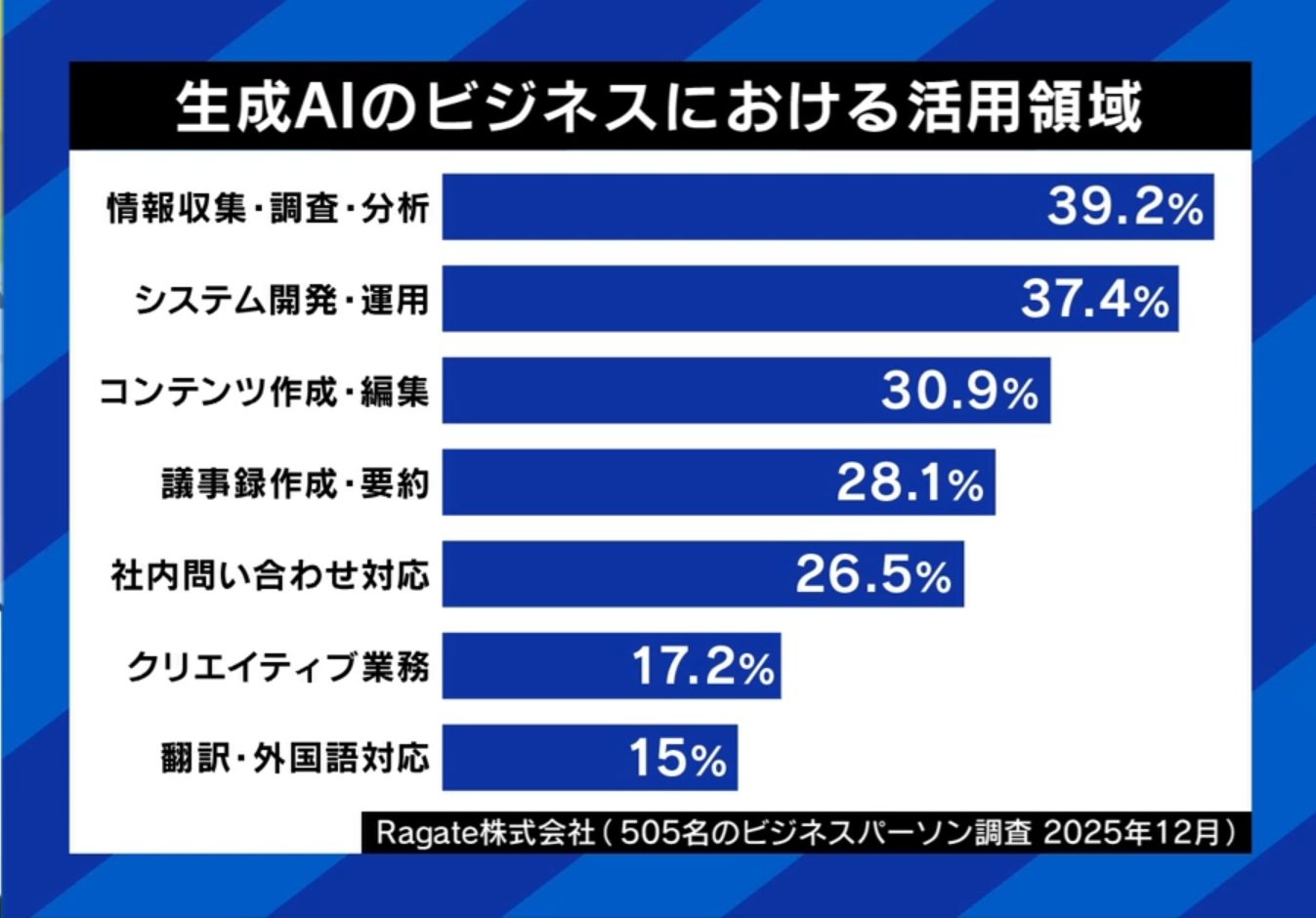

ビジネスの現場で生成AIの活用が急速に進む中、あえて「新人には使わせない」という決断を下す企業が現れ話題となっている。ある調査によれば、AIは情報収集や分析、会議の議事録作成、問い合わせ対応など、多岐にわたる分野で効率化に貢献している。エンジニアの一人は「AIがなかった時に1時間、場合によっては2時間とか数時間かかっていたものが、5分とか10分ぐらいでできるようになった。AIなしは今では考えられない」と、その劇的な恩恵を語る。一方で「新人はAI使用禁止!」というルールを打ち出す動きも出ている。この教育方針と、AI時代における「考える力」の在り方について、「ABEMA Prime」で議論が交わされた。

■800件の指摘と「AI神様扱い」の落とし穴

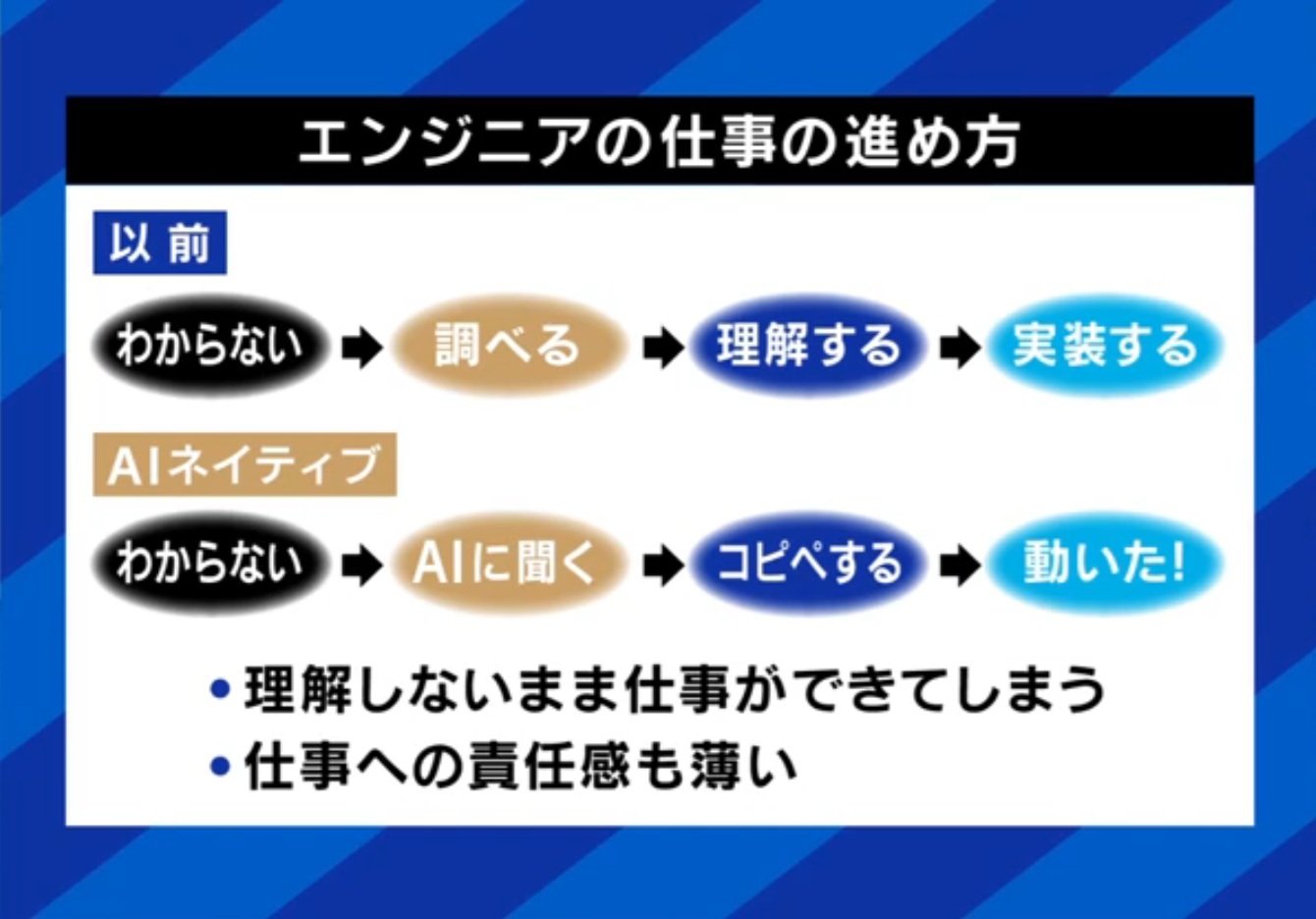

新人へのAI使用禁止に踏み切ったのは、いえらぶGROUPグループ・執行役員の和田健太郎氏だ。期待の新人エンジニアにAIツールを渡して開発を任せたところ、わずか1週間で「できました」と報告があったが、その中身を確認した際に異変に気付いたという。「いろいろなタイミングでチェックをしたが、どうも様子がおかしかった。『理解してる感じがしない』と思い確認したら、800件以上の指摘が積み重なっていて『これはマズい』と思った。1回、AIを禁止にして仕切り直した方が絶対に早いとなったのが、事の経緯だ」。

和田氏は、AIに指示書(ソースコード)をそのまま新人に投げた結果、制作過程を本人が理解できず、修正点すら分からない状態に陥っていたと分析する。実際に禁止令を受けた入社1年目の中原悠人さんは、当時の心境を振り返る。

「その時はAIが書いたものが正解だと思っていた。(AIは)こんなに間違うのだと、驚きの方が多かった。AIを完全に答えというか、神様扱いしていた」。

その後、同社では教育に注力し、一定のスキルを身につけたタイミングでAIを解禁したところ、着実に生産性が向上したという。中原さんも「シンプルに基礎体力が付いたなと思う。AI禁止期間というものを経て、自分の頭でしっかり考えるようになった、自分の実力が付いたなという感じはしている」と、その効果を実感している。

■言語脳科学者が鳴らす警鐘「人間の一番大事な部分を手放している」

この「AI依存」による弊害について、東京大学大学院教授で言語脳科学を専門とする酒井邦嘉教授は、厳しい見解を示す。

「『AIに頼る』と言った時点で、ものを考える力を身につけるという、たぶん人間に一番大事な部分を手放している。たとえば(大学の)レポートで『なんでこう書いたの』と聞いて『AIが書きました』と言われたらどうしようもない。文章を書くというのは、人間の一番基本的な能力。それを生成AIに置き換えようとすることは、かなり危険」。

さらに現在のAIも、まだ完璧な状態には遠く、そのAIに絶大な信頼を寄せることの危険性も訴える。

「実際、AIがそこまでの能力を持っているわけでもなく、バグもある。実際には画像のように言葉を合成しているのと同じなので、私は『生成AI』という言い方自体、間違っていると考えている。これは『合成AI』だ。今のAIの基本設計は、人間の脳を超すようなものではない」。

酒井氏は、効率性を追求するあまり、徹底的に繰り返して頭に刻み込むプロセスを省くことを疑問視する。

「私は、AIによる効率性そのものも疑問視してるくらい。教育は、繰り返して初めて『NO』だったことも覚える。ちゃちゃっとやって、人より短い時間で覚えても何もいいことはない。徹底的に繰り返しやって、頭に刻み込むプロセスは、人にとって喜びでもある」。

■「仕事の8割をAIに」活用派が語る役割の変化

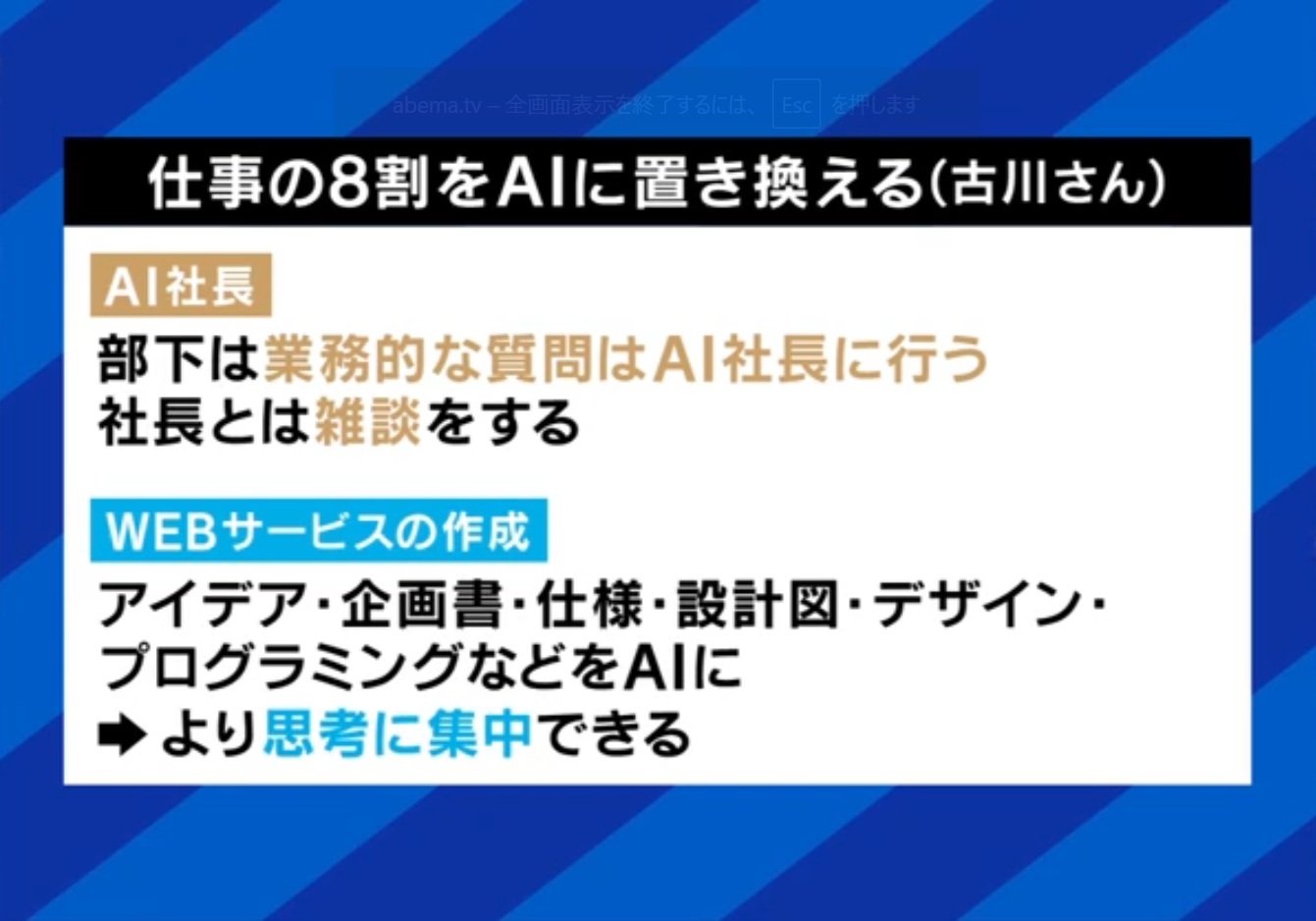

対照的に、仕事の8割をAIに任せているという、ある株式会社代表の古川健介氏は、AIによって、人間はより高度な仕事に集中できると説く。

「ワイヤーフレームという設計図みたいなものを描くと、だいたいこんな感じというのが決まっている。そういったものを作るのが一瞬で済むのは、すごく生産性が上がっている。他の時間をもうちょっと考えたり、いろいろなことを突き詰めていくという、人間がやらないといけない仕事に集中できている感じがする」。

古川氏は、AIを「部下」のような存在だと捉え、責任の所在や問いを立てる起点の部分に人間が注力すべきだと語る。

また、近畿大学 情報学研究所 所長の夏野剛氏も、エンジニアがAIを使いこなすことで、要求されるレベルが一段階上がっていると指摘する。

「今までは、いかにバグのないコードにして、それを素早くやるかが問われていた。だけど今、そんなコードは全部AIがやってくれる。そうすると今は、相手が言ってることの大本にある解決したいことは何かをしっかり聞き出し、で、それをClaude Codeを使ってシステムにする能力が問われている。今までの優秀なエンジニアより、1段上のことが要求されている」。

■「無能な人がやると詐欺師になる」AI格差への懸念

しかし、AIを使いこなすには相応の基礎能力が必要だという点では、多くの出演者の意見が一致した。ひろゆき氏は、AIの構造的な問題を指摘する。

「ChatGPTは、ユーザーが喜ぶ答えを出そうという、そもそも構造がある。7対3で『7』の方が正解だったとしても『3』の間違いを喜びそうだから『3』を答えとして出すソフトウェアだ。エンジニアも、AIが出してきたコードを見て『これは違う』と直せればいいが、その能力がない人が使うとひたすら間違ったものが出てしまう」。

ギャルタレントのあおちゃんぺ氏も、自身の漢字能力の低下を例に挙げながら、AIの危うさを独自の言葉で表現した。

「携帯電話が変換してくれるから、漢字の勉強をしなくていいとはならないし、小中学校で漢字も教える。ある程度勉強して知識があるから間違ってることに気づける。AIは優秀な人が賢くサボるためのツールであって、無能な人がなんでも丸投げしたらやってくれるお手伝いロボットではない。無能な人がやると詐欺師になるのがAI。しっかり基礎ぐらいはないとAIに遊ばれてしまう」。

また、ひろゆき氏は「今はAIのミスが多いが、このレベルがあったら全てにAIを挟んだ方が便利だし、安全だよねという時代になると思う。この議論も過渡期だからこそ」とも語っていた。 (『ABEMA Prime』より)