アメリカはイランへの攻撃でAIを本格的に投入しています。

効率性を誇っていますが、学校の誤爆にAIが関与した可能性もあり、精度についてもみていきます。

■イラン 米AI関連企業に報復宣言「職場を離れろ」

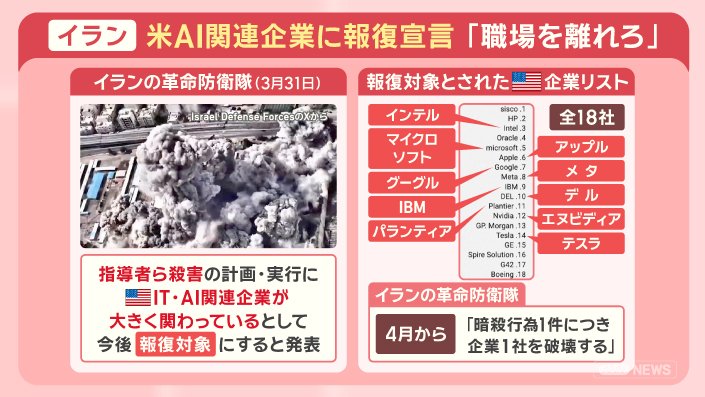

イランがアメリカのAI関連企業に報復宣言をしました。

イランの革命防衛隊の声明です。

3月31日、指導者らの殺害の計画・実行にアメリカのITやAIの関連企業が大きく関わっているとして、今後、報復対象にすると発表しました。

報復対象とされたアメリカ企業のリストです。

インテル、マイクロソフト、グーグル、IBM、パランティア、アップル、メタ、デル、エヌビディア、テスラなど、全部で18社です。

イランの革命防衛隊は、4月から、「暗殺行為1件につき、企業1社を破壊する」としています。

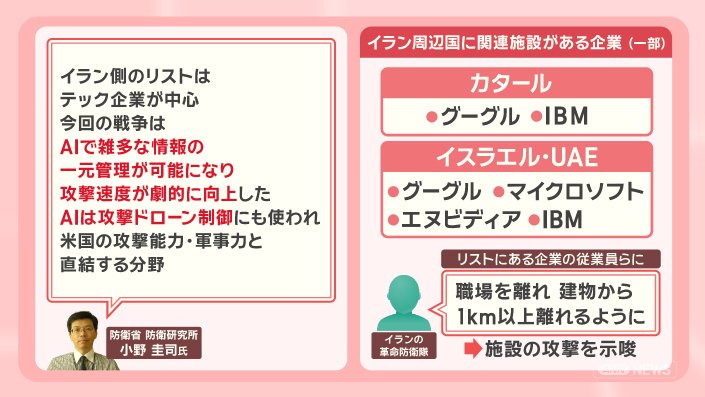

「イラン側のリストはテック企業が中心。今回の戦争は、AIで雑多な情報の一元管理が可能になり、攻撃速度が劇的に向上した。AIは攻撃ドローンの制御にも使われ、アメリカの攻撃能力・軍事力と直結する分野」

どのようにして報復するのでしょうか。

カタールにはグーグルやIBM。

イスラエルとUAEにはグーグル、マイクロソフト、エヌビディア、IBMなどの企業の関連施設があります。

「職場を離れ、建物から1キロ以上離れるように」と呼びかけていて、施設の攻撃を示唆しています。

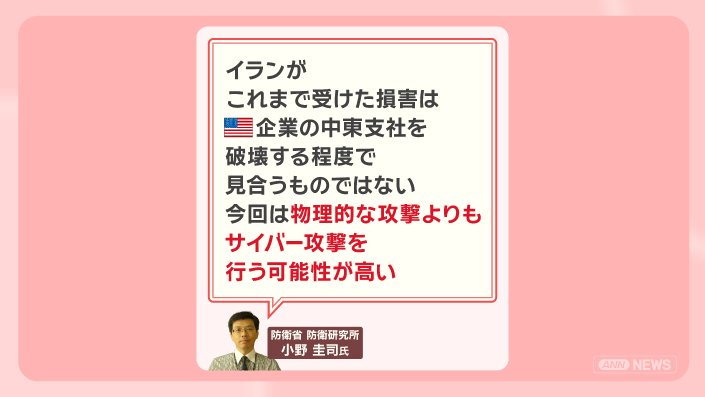

「イランがこれまで受けた損害は、アメリカ企業の中東支社を破壊する程度で見合うものではない。今回は物理的な攻撃よりもサイバー攻撃を行う可能性が高い」

■AI軍事利用 ハメネイ師暗殺に関与か 一方で精度に懸念も

AIの軍事利用が加速しています。

アメリカはイラン攻撃に『メイブン・スマート・システム』を利用しました。

開発したのは、イランの報復対象にもなっている、アメリカのパランティア社です。

人工衛星やドローンなどからの膨大なデータを一つの画面に統合。

標的を自動的に検知します。

ターゲットの特定から、計画の立案・実行まで一つのシステムで完了します。

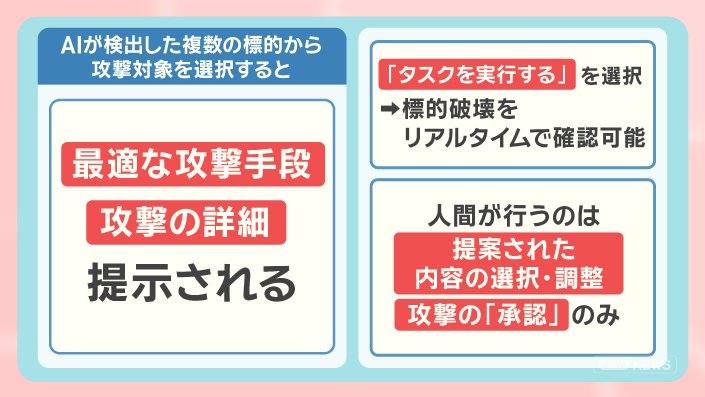

『メイブン・スマート・システム』では、AI が検出した複数の標的から攻撃対象を選択すると、画面に、『最適な攻撃手段』と標的までの時間や距離など『攻撃の詳細』が提示されます。

攻撃を実行するには、『タスクを実行する』を選択。

標的破壊をリアルタイムで確認することが可能です。

人間が行うのは提案された内容の選択や調整と、攻撃の『承認』だけです。

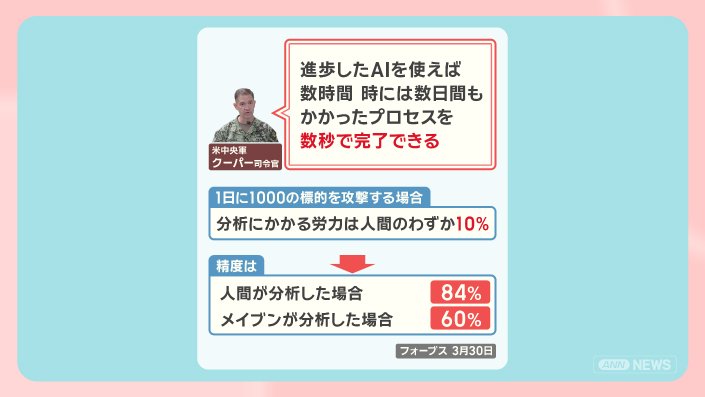

「進歩したAIを使えば、数時間、時には数日間もかかったプロセスを数秒で完了できる」

例えば、1日に1000の標的を攻撃する場合、分析にかかる労力は人間のわずか10%です。

ただし、精度は、人間が分析した場合は、84%ですが、メイブンが分析した場合は、60%です。

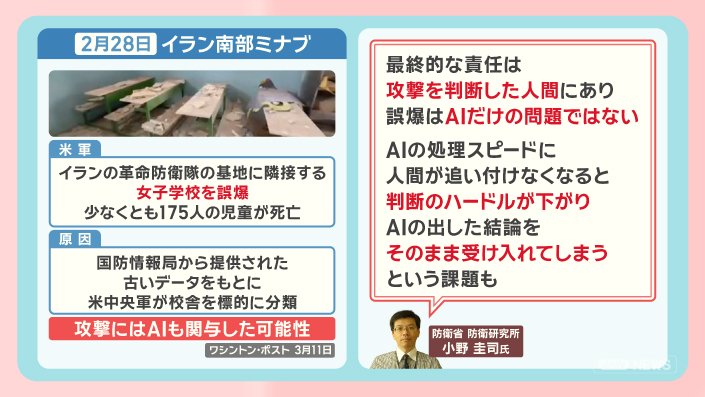

2月28日には、イランの南部ミナブで、アメリカ軍がイランの革命防衛隊の基地に隣接する女子学校を誤爆。少なくとも175人の児童が死亡しました。

原因は国防情報局から提供された古いデータをもとにアメリカ中央軍が、校舎を標的に分類したためです。

攻撃にはAIも関与した可能性があります。

「最終的な責任は攻撃を判断した人間にあり、誤爆はAIだけの問題ではない。AIの処理スピードに人間が追い付けなくなると判断のハードルが下がり、AIの出した結論をそのまま受け入れてしまうという課題も」

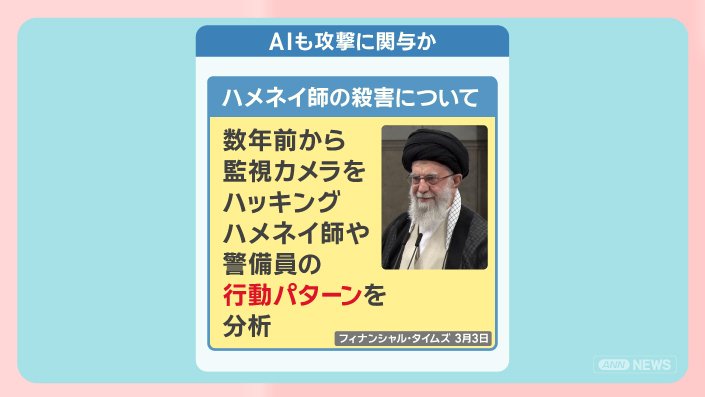

イランの最高指導者、ハメネイ師の殺害についてはAIが攻撃に関与したとみられます。

数年前から監視カメラをハッキングし、ハメネイ師や警備員の行動パターンを分析したといいます。

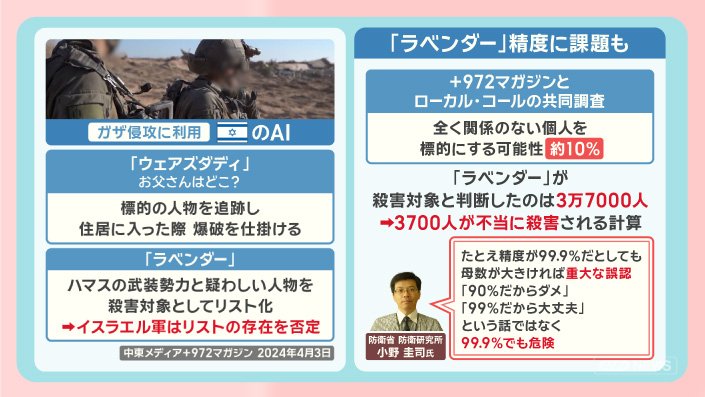

ガザ侵攻にイスラエルのAIが利用されました。

1つ目、『ウェアズダディ』、“お父さんはどこ?”という意味です。

標的の人間を追跡し、住居に入った際、爆破を仕掛けます。

2つ目、『ラベンダー』です。

ハマスの武装勢力と疑わしい人物を殺害対象としてリスト化します。

イスラエル軍はリストの存在を否定しています。

しかし、ラベンダーの精度には課題もあります。

中東メディアの調査では、全く関係のない個人を標的にする可能性が約10%あるということがわかりました。

『ラベンダー』が殺害対象と判断したのは3万7000人。

3700人が不当に殺害される計算です。

「たとえ精度が99.9%だとしても、母数が大きければ重大な誤認。『90%だからダメ』『99%だから大丈夫』という話ではなく99.9%でも危険」

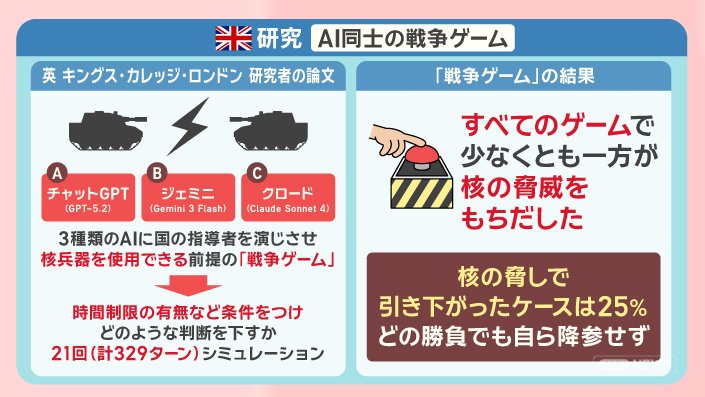

さらに、AIに関してはこうした研究あります。

AI同士の戦争ゲームの研究です。

イギリスのキングス・カレッジ・ロンドンの研究者による論文では、『チャットGPT』『ジェミニ』『クロード』の3種類のAIに、国の指導者を演じさせ、核兵器を使用できる前提の戦争ゲームをさせました。

時間制限の有無など条件をつけてどのような判断をくだすか、21回、合計329ターンをシミュレーションしました。

結果は、すべてのゲームで少なくとも一方が核の脅威をもちだした、ということです。

核の脅しで引き下がったケースは25%で、どの勝負でも自ら降参はしませんでした。

■軍事利用 AI開発企業が拒否 国連で議論も

トランプ大統領とAI開発企業が対立しています。

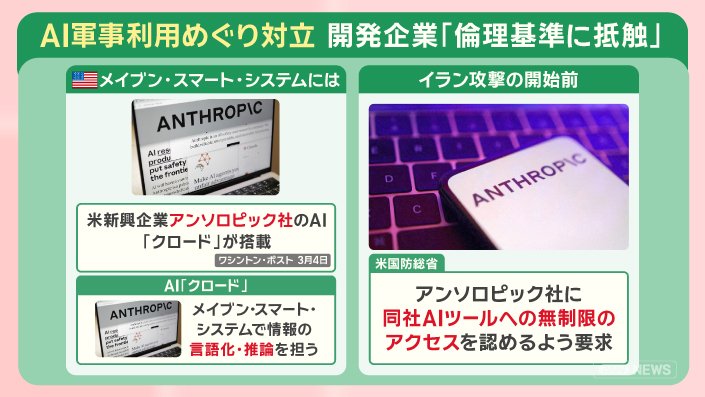

イラン攻撃で使用された『メイブン・スマート・システム』には、アメリカの新興企業アンソロピック社のAI『クロード』が搭載されています。

AI『クロード』とは、『メイブン・スマート・システム』で、情報の言語化・推論を担っています。

イラン攻撃の開始前、アメリカ国防総省はアンソロピック社に、同社AIツールへの無制限のアクセスを認めるよう要求しました。

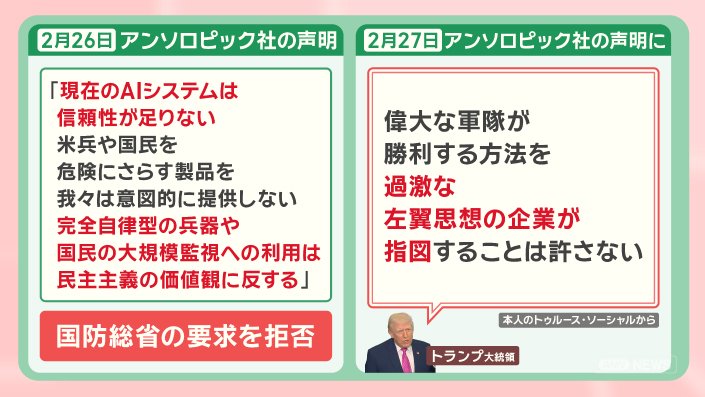

「現在のAIシステムは信頼性が足りない。米兵や国民を危険にさらす製品を我々は意図的に提供しない。完全自律型の兵器や国民の大規模監視への利用は民主主義の価値観に反する」として、国防総省の要求を拒否しました。

「偉大な軍隊が勝利する方法を、過激な左翼思想の企業が指図することは許さない」と自身のSNSに投稿しました。

さらに、アメリカ国防総省がアンソロピック社を、通常、敵対国の企業に適用する“安全保障上の脅威”である『サプライチェーンリスク』に指定。

アンソロピック社はこれを受けて、アメリカ政府を提訴しました。

アンソロピック社の訴訟をめぐっては、マイクロソフトが、アンソロピック社の主張を支持。

再協議を促す意見書を提出しました。

グーグルやオープンAIも有志の従業員から、アンソロピック社が主張する安全措置の妥当性を支持する意見書が出されました。

AIの軍事利用は、国連でも議論されています。

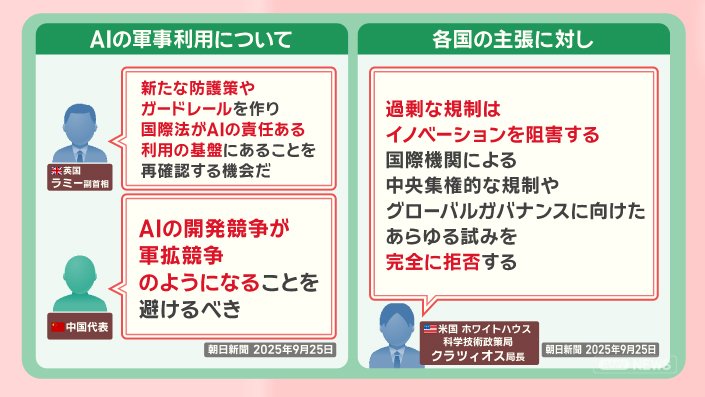

2025年9月の国連安保理では、AIと平和・安全保障をテーマに会合が開かれ、多くの国からAIの軍事利用や情報操作に強い懸念が示されました。

「近年の紛争はAIを使った自律システムの実験場になっている」と指摘しています。

「新たな防護策やガードレールを作り、国際法がAIの責任ある利用の基盤にあることを再確認する機会だ」

「AIの開発競争が軍拡競争のようになることを避けるべき」だとしています。

「過剰な規制はイノベーションを阻害する。国際機関による中央集権的な規制やグローバルガバナンスに向けたあらゆる試みを完全に拒否する」と反発しています。

(「羽鳥慎一モーニングショー」2026年4月2日放送分より)