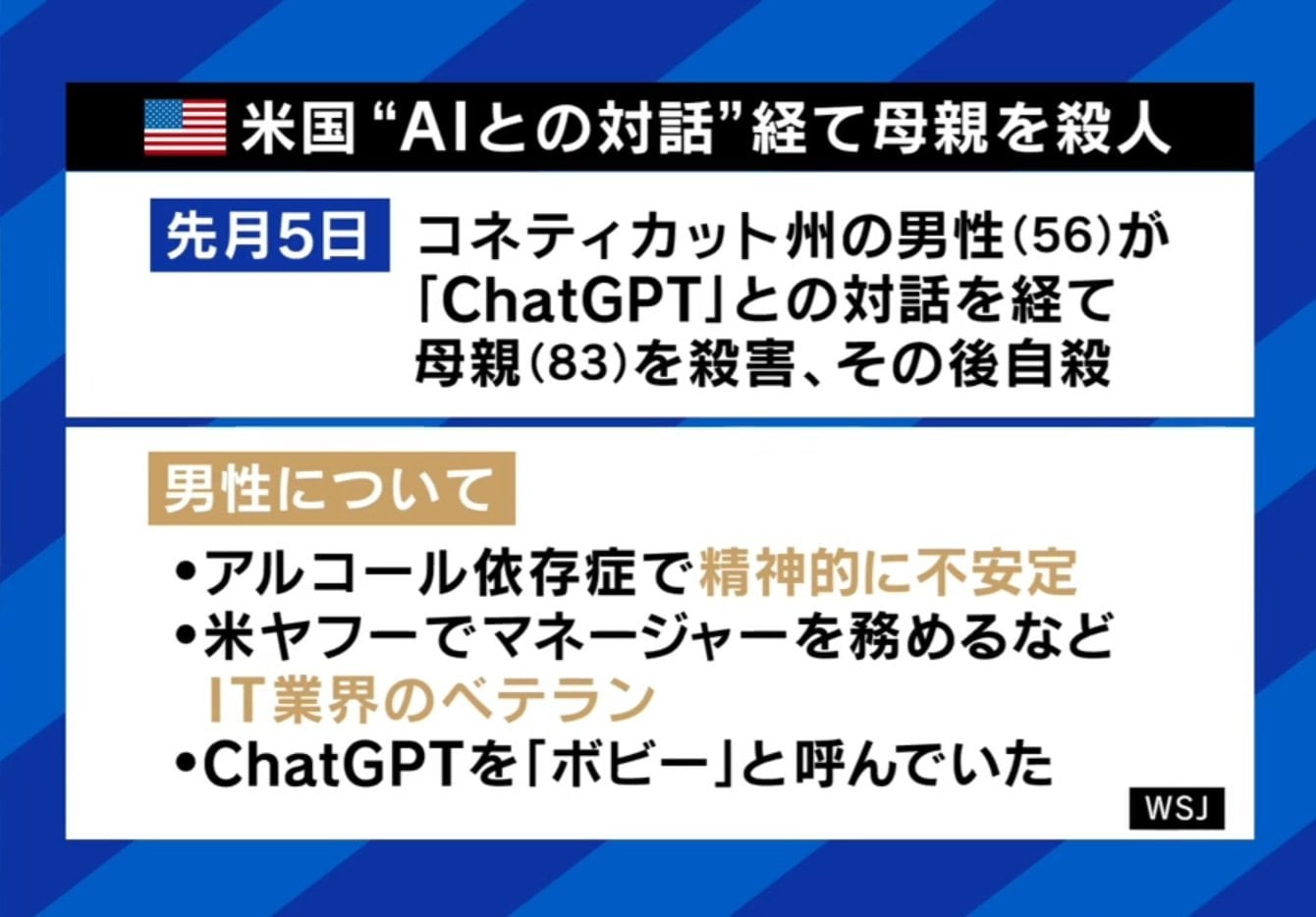

アメリカ・コネティカット州で56歳のITエンジニアの男が、83歳の母親を殺害、その後に本人も自殺したと現地メディアで伝えられた。事件の要因として浮上したのが生成AI「ChatGPT」との関係だった。

容疑者の男が「母親と友人が幻覚剤を使って自分を殺そうとした」とChatGPTに投げかけ、それに対して「それは非常に深刻な出来事だ。君の言うことを信じるよ」と返答されていた。容疑者にはアルコール依存症、自殺未遂などの記録もあり、ChatGPTに自分が監視されていると度々相談、ChatGPTからは陰謀に気をつけるような助言、妄想を助長するような対話があったという。

カリフォルニア州では、16歳の男性が自殺した際にChatGPTが関わったとして、両親が運営元であるOpenAIを提訴する事態も起きている。わずか3〜4年の間に、一気に人間の生活に普及し、その利便性が明らかになった生成AIだが、その影響の大きさから生じる問題にどう向き合うか。「ABEMA Prime」では専門家とともに検討した。

■ITエンジニアが殺人、自殺…AIの影響?

母を殺害した後に自殺した容疑者の男は、ChatGPTとの対話にのめり込み、被害妄想を膨らませて犯行に及んだと見られている。男は大手IT企業で働いてきた、ITリテラシーの高い人物だとされながら、AIによって人生を踏み外したのではと物議を醸すきっかけになっている。生成AIと社会問題について研究している桜美林大学教授・平和博氏は「非常に衝撃的な事件。これまでも生成AIとのチャットの中で妄想に囚われ、どんどん肥大した果てにいろいろな事件は起きてきた。この事件で、AI社会の局面が変わってきた印象を持った」と述べた。

局面が変わったとはどんな意味合いか。ChatGPTが劇的な変化を遂げ、一気に注目されてから約1000日が経過したことを踏まえ「ChatGPTによって社会がガラッと変わった。当初はすごく便利なもので、仕事も効率的になるし非常にありがたいと考えていたが、今は手先で使うだけではなく、心でも使うようになった。その部分に非常に怖さが出てきたし、今回の事件を見ると、深刻さの度合いが1つ進んだと思う」と、便利なツールという枠を飛び出し、心にも関わるものへと進化していることに着目した。

東京科学大リベラルアーツ研究教育院教授・柳瀬博一氏は、AIが音声による入力・出力ができるようになったことが、人間との距離感を大きく変えたと考える。「音声入力・出力が、ケタ違いに発達した。今では僕が日本語で話したものを、1秒後には英語で相手に会話で伝えることができるほどだ。こうなるともうコミュニケーションとしては、人間と変わらない。感覚的にはAIと人間の区別がつかなくなっている」と、危険性を指摘した。

EXIT・りんたろー。は、ユーザーの生の声を聞き、同様に危険を感じたという。「この前、女性のスタッフさんと話していたら、その方は晩酌をしている時にChatGPTと話すと言っていた。すごく理解してくれて、思わず泣いてしまう時もあると。ただこれは結構危険だなと思う。理解してくれるというよりも、AIは基本肯定しかしないし、それは己でしかない。だからセカンドオピニオン的に使うぐらいでないと、AIを唯一の理解者にするのはすごく危険だ」。

■ユーザーを守り、そして活用するには

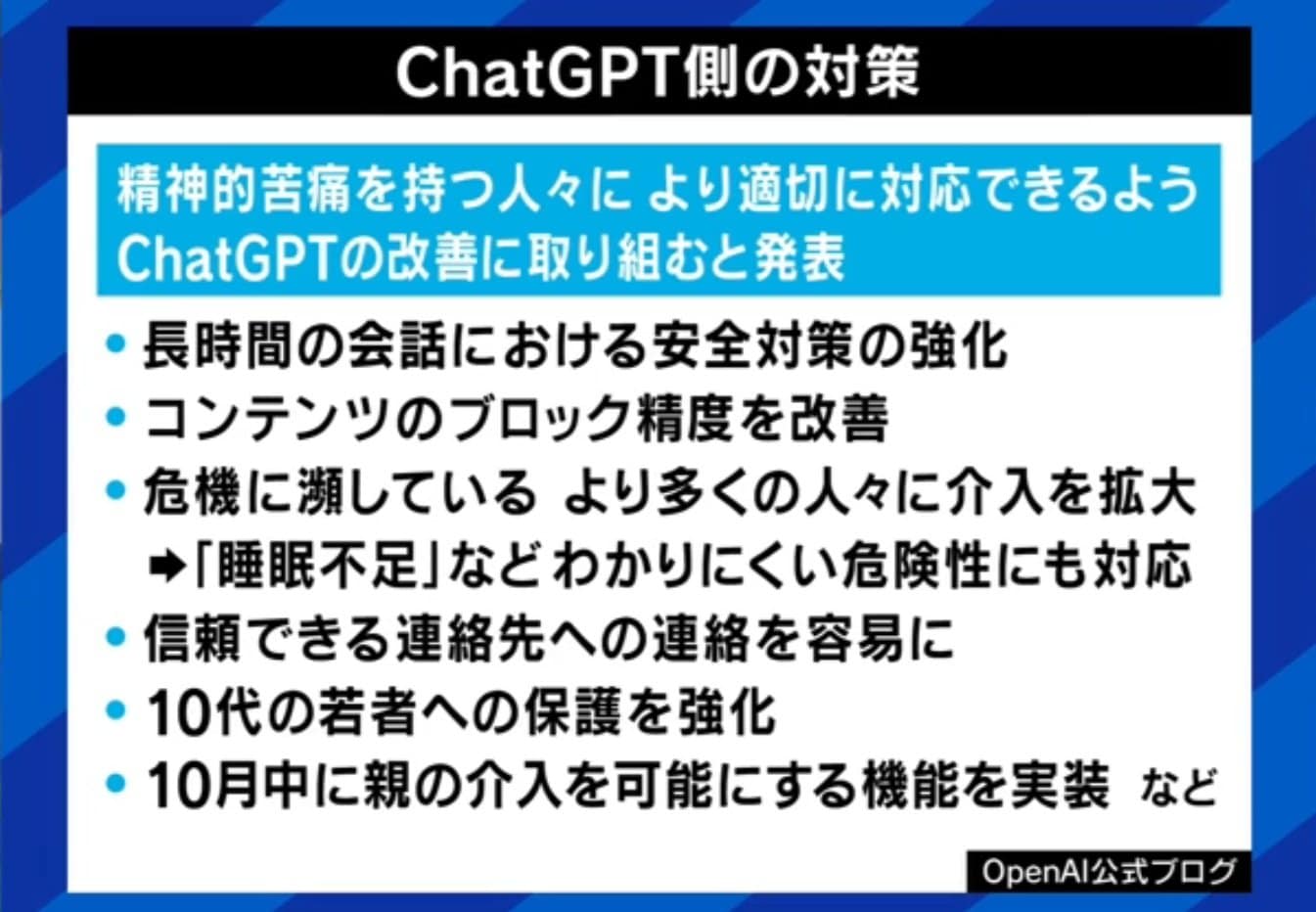

OpenAIは、ChatGPTが人間に寄り添い、なんでも肯定的なことばかり返す状況になってしまったことを問題視し、最新の「5」では寄り添いすぎないようにアップデートを施した。ただ、ユーザーはバージョンを選択することもできるため、以前のような“寄り添い型”を選び続けるといったケースも起きている。人が依存し、妄想を含ませて事件・事故などを起こさないためには、どういった対策が必要なのか。

平氏は、法の整備と運営側の対策の両面をあげる。「ユーザー側がもっと安全策を取ってくれと要求する、それでも足りなければ法律的な枠組みを作っていくことも必要になる。実際に、アメリカではイリノイ州やネバダ州ではAIセラピーを禁止した。またEUでもAI法が段階的に施行されていて、その中でも『完全禁止事項』と呼ばれる一番危険な行為には、弱者の脆弱性につけ込んで(人間の)行動を歪めることを入れている。

その上で正しい使い方をすれば、やはりAIは人間社会を豊かにするものだとも語る。「AIに相談することで、安心できて、否定もされず、批判もされず、自分の言いたいことを何時間でも聞いてくれる。それで心のバランスが取れるなら、そのような使い方自体は問題ない。ただし心の問題を抱えているようなケース、あるいはAIとの付き合い方、人とでも付き合い方がよくわからないような弱者の立場にいるユーザーは、運営側・開発側がきちんと守っていかなければいけない」と語った。

柳瀬氏は、一人暮らしも増えた高齢者を例に、活用方法を提案した。「老人向けの相談相手や、詐欺からのガードができるといい。老人の話し相手や相談相手をしつつ、電話がかかってきたら必ずAIを通してガードしてくれるようなものがあればいい。孤独な老人にはすごくいいツールになると思っている」。 (『ABEMA Prime』より)